Autonomní zabijáci. „Největší etickou otázkou je, když se stroj sám rozhodne zabít,“ říká etik

Kromě stovky různých stánků jsou na Veletrhu vědy v pražských Letňanech také přednášky. Jedna z nich nese název Autonomní zabijáci, etika vojenských robotů. „Za chyby autonomních strojů není nikdo subjektivně odpovědný,“ říká David Černý z Centra Karla Čapka pro studium hodnot ve vědě a technice na Ústavu informatiky AV ČR.

Poslechněte si speciál Magazínu Experiment ze 7. června 2025

Jste přední český odborník na etiku autonomních vojenských robotů. To je velmi zajímavé téma, které by se dalo rozebírat dlouhé hodiny. V dnešním odpoledním programu ale máte vyhrazeno 20 minut, tak o čem budete mluvit?

V těch 20 minutách se pokusím představit obě spektra názorů. To znamená na jedné straně zastánců využívání plně autonomních vojenských robotů a na druhé straně také ten druhý tábor, který se domnívá, že bychom překročili pomyslnou řeku Rubikon – a pak už není cesty zpět. Čili že máme silné důvody k tomu, abychom ty roboty vůbec nevyvíjeli a v reálných vojenských konfliktech nepoužívali.

Velmi aktuální téma. V ruském útoku na Ukrajinu figurují drony a další technologie. Jak moc jsou dnes autonomní?

Ta autonomie je otázkou míry – od nulové až po plnou autonomii. Drony jsou autonomní v určitých fázích své operace. Ale největší etickou otázkou je právě ta plná autonomie, kdy stroj nejenom identifikuje cíl, ale sám se rozhodne, že ho zlikviduje, včetně tedy toho, že zabije nějakého nepřátelského vojáka.

Když vývojáři pracují na těchto strojích – na těchto zbraních, můžeme říkat –, přemýšlí o té etice?

Určitě o ní přemýšlejí. Nemusí to být tak explicitní, že by si říkali, teďka budeme dělat etiku a teď děláme tu inženýrskou práci. Ono se to vlastně postupem času stalo takovým implicitním hodnotovým rámcem samotného inženýrství. Takže oni ve všech fázích návrhu, vývoje, výroby atd. předpokládají určitou sadu hodnot, kterou se snaží do nástrojů, které vytvářejí, vtělit.

Čtěte také

Kdyby byl ten robot úplně autonomní, kdo je pak za jeho chování odpovědný?

Ta otázka je velice složitá. Budeme se asi muset smířit s tím, že v některých situacích nebude odpovědný nikdo v tom smyslu, že nebude nikdo, kdo by se provinil. Například robot chybně identifikuje cíl, usmrtí civilistu, což je velký problém samozřejmě, ale nebude tam žádný důvod si myslet, že chyba byla na straně programátora atp. Takže tam nebude nikdo, kdo by se subjektivně provinil.

Tomu se říká subjektivní odpovědnost. Ale existuje takzvaná odpovědnost objektivní, že tady vznikla nějaká škoda, nějaká újma a musí být někdo, kdo to nahradí. A to může být třeba armáda, která bude ty stroje používat.

Mohlo by vás zajímat

Nejposlouchanější

Více z pořadu

E-shop Českého rozhlasu

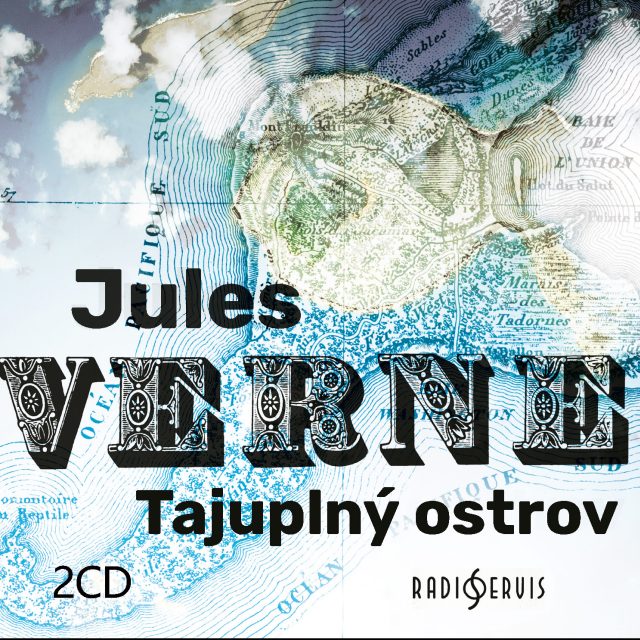

Vždycky jsem si přál ocitnout se v románu Julese Verna. Teď se mi to splnilo.

Václav Žmolík, moderátor

Tajuplný ostrov

Lincolnův ostrov nikdo nikdy na mapě nenašel, a přece ho znají lidé na celém světě. Už déle než sto třicet let na něm prožívají dobrodružství s pěticí trosečníků, kteří na něm našli útočiště, a hlavně nejedno tajemství.

Zprávy z iROZHLAS.cz

-

OVĚŘOVNA: Fiala, Křetínský a Moravec lákají na výhodné investice. Podvodníci opět zneužívají zpravodajský web

-

EXPO se Česku dále prodražuje. Teď už jde o 120 milionů korun navíc, ministerstvo chce kontrolu

-

,Jako bych přestala existovat.‘ Čínská spisovatelka se znelíbila cenzorům, na internetu ji nenajdete

-

Maďarský klášter bojuje s brouky. Ohrožené jsou desetitisíce vzácných historických knih